सन् २०२४ को वर्षलाई अनेक विशेषताले चिन्न सकिएला । तर त्यस वर्षलाई ‘सुपर इलेक्सन इयर’ अर्थात् महा-निर्वाचन वर्षको रूपमा मानिसहरूले चिन्ने छन् ।

त्यस समय विश्वका ६० भन्दा बढी देशका ४ अर्बभन्दा बढी मानिसहरू मतदानका लागि योग्य थिए। लोकतन्त्रको वैधानिकतालाई अझ व्यापक बनाउनुसँग यी सङ्ख्याहरूले अवश्य योगदान गरेका थिए । तर यो सँगसँगै हामीले सिक्काको अर्को पाटोलाई वेवास्ता गर्न सक्दैनौं ।

त्यो सिक्काको अर्को पाटो भनेको विशेषज्ञहरूले नाम दिएको विश्वव्यापी इन्फोडेमिक ( सूचनाको महामारी ) निर्वाचनको धरातलमा वास्तविक भएर अवतरित भयो । पहिलो पटक जेनेरेटिभ एआई एउटा सैद्धान्तिक खतराबाट हटेर राजनीतिक युद्धको मैदानमा एक तीव्र वेगको हतियारको रूपमा देखा पर्यो ।

उक्त खतरा यस सीमासम्म पुगेको थियो कि, जहाँ एउटा डीपफेकले नै चुनावी नतिजा उल्ट्याउने अनुमान सम्म गरिएको थियो । यो एआई एपोक्लिप्सको अर्को उदाहरण थियो । तर यस हदसम्मको अनुमान अनुसार नतिजा नदेखिए पनि एआईले ‘स्लो-ड्रिप’ (सुस्त तर निरन्तर) शैलीमा भ्रम फैलाएर मतदाताहरूको साझा यथार्थलाई विकृत भने बनाइदियो ।

संयुक्त राज्य अमेरिकाको राष्ट्रपतिको चुनाव

लगभग एक दशक अघि नै ट्रम्पले फेसबुकबाट ५ करोडभन्दा बढी डेटाहरूको दुरुपयोग गरी आफ्नो पक्षमा सकारात्मक छवि निर्माण गर्न अल्गोरिदमको प्रयोग गरिएको थियो ।

तर, २०२४ को चुनाव भने योभन्दा भीषण रुपले प्रविधिको दुरूपयोग गरियो । एआईको प्रयोगबाट असत्य समाचारहरूको प्रसारण मात्र गरिएन, विद्यमान जातीय र राजनीतिक विभाजनहरूलाई थप गहिरो बनाउने काम समेत गरियो ।

एआई क्लोनहरूको व्यापक प्रयोग

सन् २०२४ को जनवरीमा, राष्ट्रपति जो बाइडेनको आवाजसँग हुबहु मिल्ने एआई-निर्मित ‘क्लोन’ आवाज प्रयोग गरी न्यू ह्याम्पशायरका करिब २५,००० मतदातालाई फोन गरियो ।

उक्त आवाजले बाइडेनको शैलीमा बोल्दै समर्थकहरूलाई ‘आफ्नो भोट नोभेम्बरको चुनावका लागि जोगाउन’ र प्राइमरी चुनावमा घरमै बस्न आग्रह गर्यो । यो अमेरिकी इतिहासमा प्रत्यक्ष मतदाताको विवेकमाथिको नियन्त्रणको लागि एआईको पहिलो उच्चस्तरीय प्रयोग थियो । संघीय सञ्चार आयोग (एफसीसी) ले तुरुन्तै रोबोकलमा एआई आवाजको प्रयोगलाई अवैध घोषणा गर्यो । तर, यसले ५०० डलरभन्दा कम खर्चमा ठूलोस्तरको गर्न सकिन्छ भन्ने नजिर स्थापना गरिदियो ।

जुलाई २०२४ मा, एउटा अत्यन्तै परिष्कृत एआईद्वारा निर्मित भिडियो सार्वजनिक भयो । जसमा कमला ह्यारिसको वास्तविक चुनावी विज्ञापनलाई तोडमोड गरिएको थियो ।

उक्त भिडियोमा उनको वास्तविक आवाजलाई एआईद्वारा बनाइएको नक्कली आवाजसँग प्रतिस्थापित थियो । यस भिडियोमा ह्यारिसले आफूलाई ‘विविधताको कोटाबाट नियुक्त भएको’ भनेको र ‘आफूलाई देश चलाउनेबारे केही पनि थाहा नभएको’ बताएको देखाइएको थियो ।

साथै, उक्त एआई आवाजले राष्ट्रपति बाइडेनको ‘स्मरणशक्ति कमजोर भएको’ कुरा बाहिर आएकाले मात्र आफू उम्मेदवार बनेको दाबी समेत गरेको थियो ।

एलन मस्कले एक्समा सेयर गरेपछि यो भिडियो व्यापक रूपमा फैलियो । कुनै स्पष्टीकरण आउनुअघि नै यसलाई १३ करोड भन्दा बढी पटक हेरिसकिएको थियो ।

यो भिडियो बनाउने क्रिएटर यूट्युबर ‘मिस्टर रेगन’ ले यसलाई एउटा व्यङ्ग्यको रूपमा उल्लेख गरेका थिए । तर आलोचकहरूकाअनुसार जब यो भिडियो कुनै चेतावनीविना ठूला व्यक्तिहरूद्वारा पुनः सेयर गरियो तब धेरै दर्शकहरूका लागि यो वास्तविक हो कि भ्रामक सूचना हो भनेर छुट्याउन असम्भव भएको थियो ।

फैलिएको जातीय प्रोपगाण्डा

एआईको प्रयोग जातीय प्रोपगाण्डाका लागि पनि प्रयोग गरिएको थियो । सामाजिक सञ्जालहरू एआई-निर्मित न्यून गुणस्तरका तर अधिक संख्याका तस्वीरहरूले भरिएका थिए ।

डोनाल्ड ट्रम्पलाई काला जातिका समर्थकहरूसँग हाँसिरहेको देखाइएको फेक तस्बिरहरू बनाइयो । यी तस्बिरहरूमा हातका औंलाहरू छ वटा हुने वा पृष्ठभूमि बिग्रिएको जस्ता एआईका त्रुटिहरू त थिए ।

यद्यपि तिनको उद्देश्य प्राविधिक रूपमा परिष्कृत हुनु भन्दापनि अल्पसंख्यक समूहहरूमा ट्रम्पको लोकप्रियता बढ्दैछ भन्ने भ्रमपूर्ण माहोल सिर्जना गर्नु थियो ।

त्यस्तैगरी आप्रवासीहरूलाईलाई नकारात्मक आलोकमा चित्रण गर्ने काम पनि एआइबाट प्रशस्त रुपमा भएको थियो ।

२० सेकेन्डको एउटा भिडियो जसमा हाइटीका एक आप्रवासीले जर्जियामा कमला ह्यारिसका लागि धेरै पटक मतदान गरेको झुटो दाबी गरिएको देखाइएको थियो ।

व्यापक रूपमा फैलाइएको यो भिडियो निर्वाचनको निष्पक्षतामाथि शङ्का उत्पन्न गराउने र जातीय तनाव भड्काउने एउटा बृहत् प्रयासको हिस्सा थियो ।

लायर्स डिभिडेन्ड

यस निर्वाचनमा एआइको सबैभन्दा हानिकारक प्रभावको रूपमा नक्कली समाचार मात्र थिएन । यसबाट साँचो समाचारलाई पनि झुटो भनेर खण्डन गर्ने लुपहोल पनि प्राप्त भएको थियो ।

दुवै प्रमुख दलहरूले ‘लायर्स डिभिडेन्ड’ को प्रयोग गरे जसमा राजनीतिज्ञहरूले आफ्ना विरुद्धका वास्तविक र नकारात्मक फुटेजहरूलाई एआई-निर्मित भन्दै पन्छिने मौका पाए ।

यसले जनतामा एउटा यस्तो निराशावादी सोच पैदा गरिदियो कि, यदि सबै कुरा नक्कली हुन सक्छ भने कुनै पनि जानकारीको सत्यतामा विश्वास गर्ने आधार नै रहेन ।

भारत: बृहत्स्तरको प्रयोगशाला

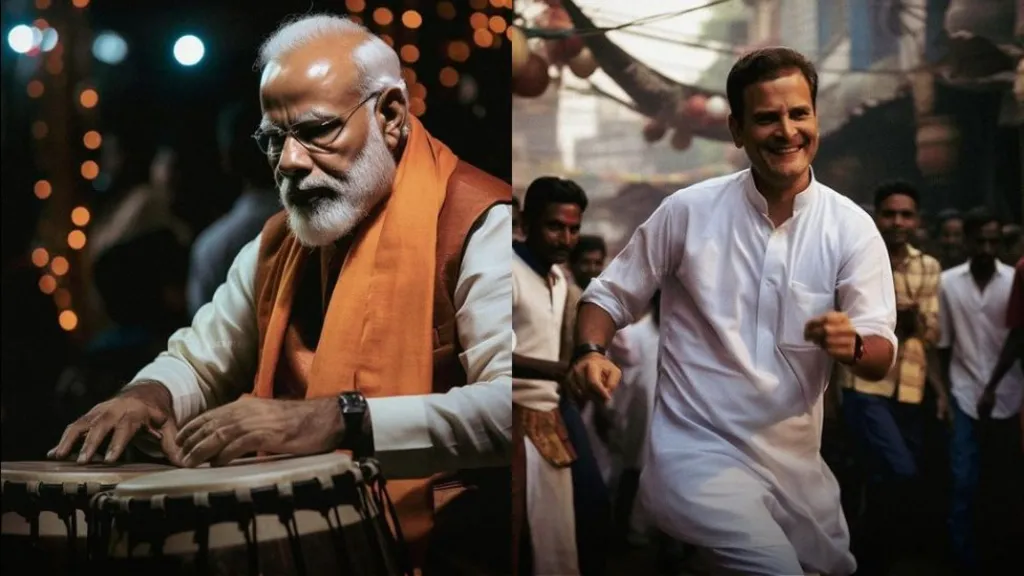

भारतको सन् २०२४ को आम निर्वाचन राजनीतिक एआईको प्रयोगको सन्दर्भमा विश्वकै सबैभन्दा ठूलो प्रयोग बन्यो । विशाल जनसंख्या र सक्रिय ह्वाट्सएप संस्कृतिका कारण प्रोपागान्डाको स्तर अभूतपूर्व देखियो ।

राजनीतिक दलका ‘आईटी सेल’हरूले विपक्षी नेताहरूले नबोलेका कुराहरू बोलेको देखाउने डिपफेक भिडियोहरू बनाए ।

अत्यन्तै संवेदनशील जातीय र सामाजिक मुद्दाहरूमा पनि डिपफेक भिडियोहरू बनाइए । भाजपाका नेता एवम् गृहमन्त्री अमित शाहको भिडियोलाई तोडरोड गरी उनी पिछडिएका जातिहरूको आरक्षण (कोटा) समाप्त गर्न चाहन्छन् भन्ने देखाइयो ।

दक्षिण भारतमा डीएमके पार्टीले सन् २०१८ मा निधन भएका नेता एम. करुणानिधिको एआई अवतार प्रयोग गरी उनका छोरा एम.के. स्टालिनको पक्षमा समर्थन जनाउन लगायो । पार्टीले यसलाई भावनात्मक सम्बन्धको संज्ञा त दियो । तर यसले मृतकको सहमतिको हक र यस्ता डिजिटल प्रेतहरूलाई साम्प्रदायिक प्रोपागान्डामा प्रयोग गर्न सकिने नैतिक प्रश्नहरू खडा गर्यो ।

एआईलाई धार्मिक तनाव बढाउन पनि प्रयोग गरियो । प्रमुख मुस्लिम नेताहरूले हिन्दू विरोधी टिप्पणी गरिरहेको जस्तो सुनिने डिपफेक अडियोहरू स्थानीय र्यालीहरूमा फैलाइयो । यी अडियोहरूलाई एआई-डिटेक्टरले चिन्न नसक्ने गरी कम गुणस्तरको बनाएर ग्रामीण मतदाताहरूलाई लक्षित गरिएको थियो ।

भारतका केही मुस्लिम र धर्मनिरपेक्ष नेताहरूले ‘हिन्दूहरूको आरक्षण खोसेर मुस्लिमलाई दिने’ बोलेको भनी दाबी गरिएका अडियो क्लिपहरू ह्वाट्सएप ग्रुपहरूमा भाइरल बनाइएका थिए ।

पाकिस्तानको चुनावमा एआई राज्य प्रायोजित भ्रमको साधन

पाकिस्तानमा फेब्रुअरी २०२४ को चुनावमा एआई राजनीतिक अस्तित्व रक्षा र राज्य-प्रायोजित भ्रम दुवैको हतियार बन्यो ।

पूर्व प्रधानमन्त्री इमरान खान जेलमा र सञ्चारमाध्यममा प्रतिबन्धित हुँदा पनि उनको पार्टी पीटीआईले एआई भ्वाइस-क्लोनिङ प्रविधि प्रयोग गरी युट्युब र भर्चुअल र्यालीहरूमा उनको भाषणहरू प्रस्तुत गर्यो। यसले उनलाई भौतिक रूपमा अनुपस्थित भएर पनि चुनावी मैदानमा ‘जीवित’ राख्यो ।

यसको विपरीत चुनावको अघिल्लो रात खानले चुनाव बहिष्कार गर्न आह्वान गरेको एउटा डिपफेक अडियो सार्वजनिक गरियो । यो अन्तिम समयमा गरिएको षड्यन्त्र थियो जसको उद्देश्य उनका समर्थकहरूलाई अलमलमा पार्नु थियो ।

स्लोभाकियामा ४८ घन्टे टर्निंङप्वाइन्ट

स्लोभाकियामा २०२४ मा सम्पन्न चुनाव एआईको प्रयोगबाट मतदाताहरूको मनस्थिति कसरी सानो समय अवधिमै परिवर्तन गर्न सकिन्छ भन्ने कुराको डरलाग्दो उदाहरण बन्यो ।

चुनावको ठीक दुई दिन अगाडिको मौन अवधिमा स्लोभकियामा एउटा एआई निर्मित अडियो सामग्री सार्वजनिक भयो ।

अडियोमा उदारवादी दलका नेता मिचाल सिमेक्काले चुनाव धाँधली गर्ने र वियरको मूल्य बढाउनेबारे छलफल गरिरहेको जस्तो सुनिन्थ्यो ।

मौन अवधिका कारण सिमेक्काले कानुनी रूपमा टेलिभिजन वा पत्रपत्रिकामा यसको खण्डन गर्न पाएनन् । अडियो टेलिग्राम र फेसबुकमा भाइरल भयो ।

चुनावी सर्वेक्षणमा अगाडि देखिएको उनको पार्टीले अन्ततः झिनो अन्तरले पराजय भोग्यो । एआईकै कारण पराजय भएको पुष्टि गर्न नसकिए तापनि यसले चुनावी अन्तिम ४८ घण्टामा उम्मेदवारलाई कसरी असहाय बनाउन सकिन्छ भन्ने कुरालाई भने प्रष्ट रूपमा प्रस्तुत गरेको थियो ।

बेलायतको निर्वाचनमा एआई उम्मेदवार

जुलाई २०२४ को बेलायतको चुनावमा एआई पर्दा पछाडिबाट सिधै मतपत्रमै पुग्यो । मानौं कि, राजनीति राजनीतिज्ञहरूको लागि मात्र छाड्नु अत्यन्त गम्भीर कुरा हो भन्ने उद्दरणलाई सिद्ध गर्नका लागि एआई उम्मेदवार चुनावमा खडा भएको थियो ।

स्टिभ इन्डाकोट नामका एक उम्मेदवार ‘एआई स्टिभ’ को रूपमा चुनाव लडे । उनको प्रतिनिधित्व एक एआई एभटारले गर्थ्यो जसले मतदाताहरूसँग २४ सै घण्टा अन्तर्क्रिया गर्थ्यो। उसले मतदाताहरूको प्रतिक्रियाका आधारमा संसदमा भोट हाल्ने वाचा गरेको थियो ।

बेलायत सरकारले रुस र चीनमा आधारित ‘बोट-फार्म’ हरूको अनुसन्धान गर्यो, जसले एआई प्रयोग गरी अध्यागमनका विषयमा उग्र टिप्पणीहरू फैलाएका थिए । यी अकाउन्टहरूले जातीय विभेदका कथाहरूलाई बढवा दिँदै देशमा नागरिक अशान्ति हुन लागेको भ्रम सिर्जना गरेका थिए ।

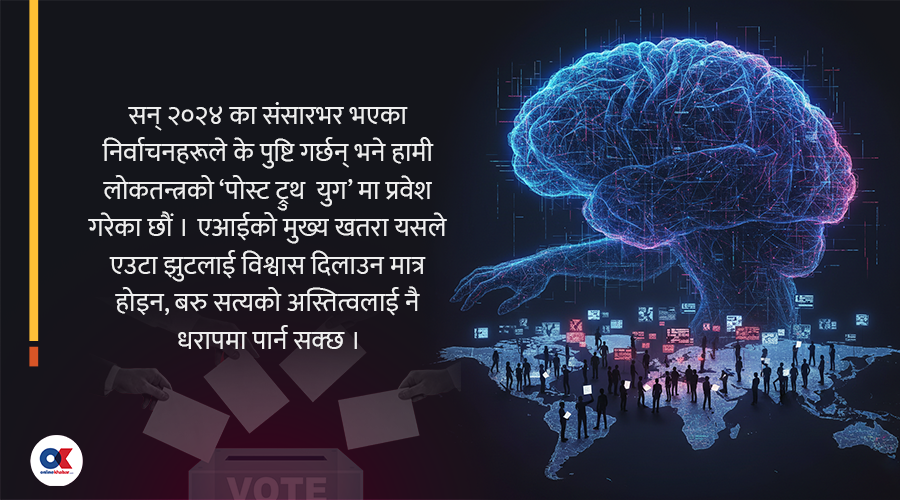

पोस्ट ट्रुथ युग र निर्वाचन

सन् २०२४ का संसारभर भएका निर्वाचनहरूले समान्य रूपमा के पुष्टि गर्छन् भने हामी लोकतन्त्रको ‘पोस्ट ट्रुथ युग’ मा प्रवेश गरेका छौं । एआईको मुख्य खतरा यसले एउटा झुटलाई विश्वास दिलाउनु मात्र होइन, बरु यसले सत्यको अस्तित्वलाई नै धरापमा पार्न सक्छ । जब मतदाताहरू साँचो र झुटो छुट्याउन नसकेर क्लान्त हुन्छन्, तब उनीहरू कि त आफ्नै पुरानो पूर्वाग्रहमा अडिन्छन् वा लोकतान्त्रिक प्रक्रियाबाटै अलग हुन्छन् ।

यी चुनावहरूको सर्सर्ती हेर्ने हो भने भ्रामक सूचनाविरुद्धको लडाईं अब ‘तथ्य-जाँच’ बाट ‘प्रि-बन्किङ’ अर्थात् षड्यन्त्रका रणनीतिहरूका बारेमा पहिल्यै सुचित गराउने तर्फ मोडिएको छ । (एजेन्सीहरूको सहयोगमा)

.jpg)

प्रतिक्रिया 4