काठमाडौं । विभिन्न गलत कामहरुमा समेत आर्टिफिसियल इन्टेलिजेन्स (एआई) को प्रयोग सुरु भएको छ । ग्राफिका नामक एक सोसल नेटवर्क विश्लेषण कम्पनीले यसको खुलासा गरेको छ । कम्पनीले तयार पारेको रिपोर्ट अनुसार आर्टिफिसियल इन्टेलिजेन्सका माध्यमबाट महिलाहरुका नग्न तस्वीर तयार पार्ने एप तथा वेबसाइटहरुको लोकप्रियता तीव्र रुपमा बढिरहेको छ ।

ग्राफिकाका अनुसार गत सेप्टेम्बर महिनामा २ करोड ४० लाख प्रयोगकर्ताले यस्ताखाले वेबसाइटहरु हेरेका छन् । त्यसमध्ये अधिकांशमा निर्वस्त्र पार्ने सर्भिसको मार्केटिङका लागि लोकप्रिय सोसल मिडिया नेटवर्कहरुको प्रयोग भैरहेको छ । यो वर्षको सुरुवातदेखि अहिलेसम्म सोसल मिडिया प्लाटफर्ममा यस्ता प्रकारका विज्ञापनहरुमा २४ सय प्रतिशतको वृद्धि देखिएको छ ।

सोसल मिडिया प्लाटफर्महरु रेडिट तथा एक्समा समेत त्यसको प्रचार भैरहेको छ । निर्वस्त्र तस्वीर तयार पार्ने त्यस्ता एप तथा वेबसाइटहरुले एआईको प्रयोग गरेर तस्वीरलाई पुनर्सिर्जना गर्दछन् । जसमा तस्वीरमा रहेको व्यक्तिका कपडाहरु हटाइन्छ । तीमध्ये अधिकांश सर्भिसहरुले केवल महिलाहरुको तस्वीरमा मात्रै काम गर्दछन् ।

यी एपको सहयोगमा कसैको अश्लील तस्वीर तथा भिडियोहरु तयार पारेर त्यसलाई प्लाटफर्महरुमा वितरण गर्न सकिन्छ । यी एपहरुले एआईको सहयोगमा कुनै पनि व्यक्तिको आपत्तिजनक भिडियो तयार पार्न सक्दछन् ।

सजिलो भाषामा भन्नुपर्दा यसको प्रयोग ‘डिपफेक पोनोग्राफी’मा गरिन्छ । यस्ता खालका भिडियोहरु सिर्जना गर्नका लागि सोसल मिडिया प्लाटफर्महरुबाट समेत तस्वीरहरु तानेर त्यसलाई गलत तरिकाले प्रयोग गर्न सकिन्छ ।

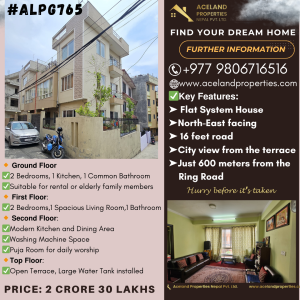

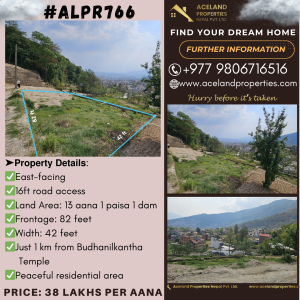

सोसल मिडिया प्लाटफर्म एक्समा एउटा यस्तै तस्वीर पोस्ट गरी त्यसको प्रचार गरिएको छ । कपडा खोलिदिने अर्थात् अनड्रेसिङ एपको प्रयोग गरेर यस्तो तस्वीर तयार गर्न सकिने त्यसमा उल्लेख छ । एउटा एपले गुगलको युट्युबमा प्रायोजित सामग्रीका लागि शुल्क तिरेको छ र nudify शव्द सर्च गर्दा सुरुमा त्यही नै देखिन्छ ।

यस विषयमा गुगलका एकजना प्रवक्ताले भनेका छन् कि कम्पनीले यस्ता खालका विज्ञापनलाई अनुमति दिँदैन जसमा स्पष्ट रुपमा यौनिक सामग्रीहरु सामेल हुन्छन् ।

तस्वीरका कपडा खोलिदिने एपको विज्ञापनका विषयमा बोल्दै उनले कम्पनीले त्यस्ता एपको समीक्षा गरेको र कम्पनीको नीति उल्लंघन गर्ने विज्ञापनहरु हटाउन थालिएको बताए । एक्स र रेडिटले भने यो विषयमा कुनै प्रतिक्रिया दिएका छैनन् ।

स्मरण रहोस् नन कन्सेन्सुअल अर्थात् विना सहमतिका पोनोग्राफी लामो समयदेखि इन्टरनेटमा विद्यमान छ । खासगरी सार्वजनिक व्यक्तित्व अर्थात् चर्चित व्यक्तिहरु यसको सिकार बनिरहेका छन् । यसलाई एआई प्रविधिले झनै मलजल गरिरहेको छ र गोपनीयता विज्ञहरुले यो प्रविधिलाई लिएर प्रश्न उठाइरहेका छन् । किनकि यसको प्रयोगबाट सजिलैसँग डिपफेक भिडियो बनाउन सकिन्छ ।

– एजेन्सी

%20-%20Copy.jpg)

.jpg)

प्रतिक्रिया 4